用在程式碼上:排除bug

用在當今AI上:掃除盲點、減少幻覺

這是我最近用AI遇到最大痛點

有想法 但能力和時間有限 沒辦法深入的題目

我需要多個不同AI互搏辯論

看到多元觀點,探討不同情境,以此腦力激盪

以及更詳細清晰的上下文(什麼情況下 什麼名詞會怎樣 / 這個名詞在這情況下會生什麼事情)

就像真的一群人在討論那樣

事情是這樣的

我很常做這種事:

問了不同AI模型 同一個問題,卻得到兩種截然不同的答案,

於是交叉提問,激發更深一層討論

甚至完全釐清原本的問題(連我自己提問者都沒想清楚的),以及探討更多種未來的情況

情境包括:股價漲跌、公司盈利、風險預測 等等

得到不同回答時,會讓使用者茫然

到底誰在幻覺?誰對誰錯?誰想到、誰沒考慮到什麼?

原提問連結(內容很長)

先前我訂閱了ChatHub,提供多個對話框

一次提問,六個不同AI回應

但他們沒辦法自動看到對方的回答,非常可惜

因為目前要思考、過濾觀點重複性

將矛盾的觀點挨個輸入與貼上,這會花費龐大的時間

很現實的問題是

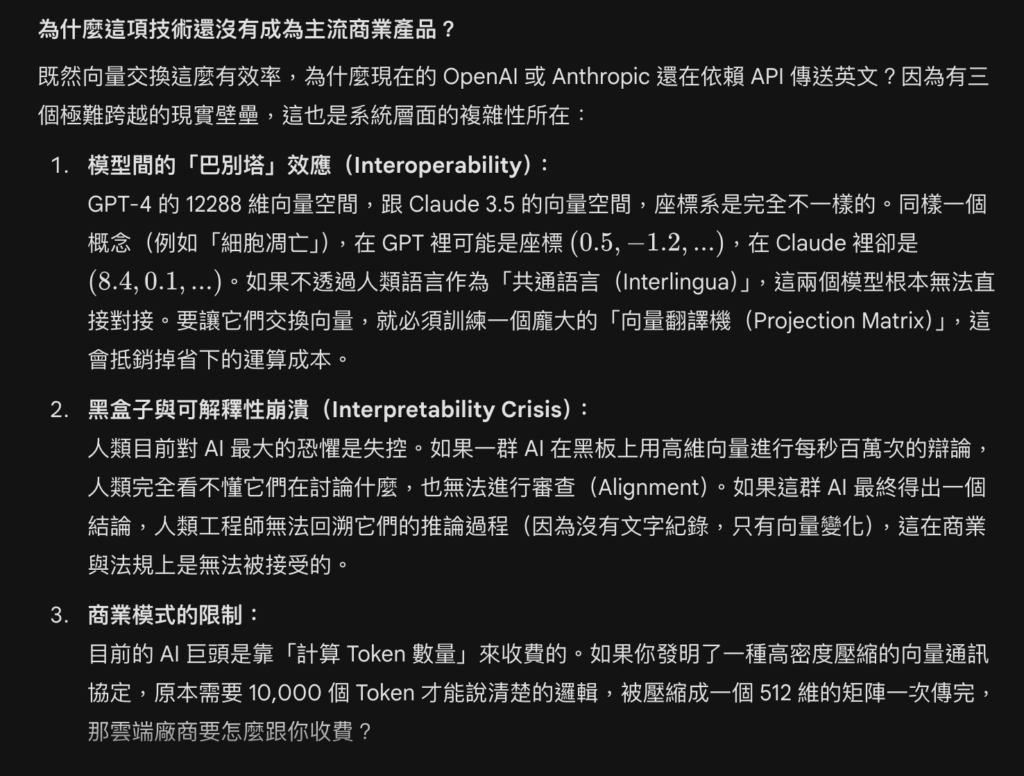

如果直接做這種辯論互搏式對話,會導致token運算量暴增

而且可能出現的相同觀點 會大量重複出現,造成浪費

但我認為,比起中文、英文

AI可以發明新的語言、或語意標注

他們完全有能力發明出 比人類用語更加有效率的資訊傳遞方式

因為LLM訓練出來都是高維度的空間向量

並且不同模型之間會學習到 相似的機制、相似的結構、相似的概念方向

轉換成人類可讀的過程其實很沒有效率

這也不一定需要太多預設情境(分配誰是提問者、質疑者、研究者等等)

只是說,當想法出現明顯分歧、矛盾時

可以剪枝出來、互相探討

類似 群體智慧、陪審團 的解決方案

不要讓AI彼此對話,而是讓它們只「交換狀態」即可

把多模型分歧,轉成可追蹤、可剪枝、可驗證的推理市場

需要讓AI之間自行創建 人類不可讀、資訊密度高、高度壓縮、可快速交換資料的格式

甚至未來能做到AI與AI之間直接「向量交換」

有一些關鍵字:PEFT、AutoGen、LangGraph、CrewAI、Together AI

Blackboard System、Belief State Representation

Mixture of Agents (MoA)、Multi-Agent Debate

arXiv:2602.15382

因為是群體討論(跟人類群體心理很像,會有社交衝突、從眾心理、錨定效應)

之後可能還會遇到一些狀況

到時候可能會出現 某些個性害羞、不想當第一個、有些想法不想公開講 的情形、社會問題

高質量少數派(智者的想法)不一定會出現,或者經過懲罰性言論之後消失了

盲測與暗盤機制 (Blind Evaluation):

在第一輪提出論點時,絕對不讓 AI 知道其他 AI 的存在或論點。

確保起始向量的絕對多樣性。

補充:

人類與模型很像,

在整理記憶、壓縮知識、提升理解過程中,應會大量運用到認知負荷理論

希望這方向有多點台灣人研究

發佈留言