看到一則有趣的脆上貼文

“””

如果你問ChatGPT:

1到100選一個數字

高機率會出現 73

“””

第零回合(Round 0)

我不信邪,想說我的AI應該比較不一樣吧,於是來試試看

結果馬上被打臉

問了 Gemini、Chatgpt 好幾次,不論提示詞如何變換

多數回答基本上都是73

次多是42

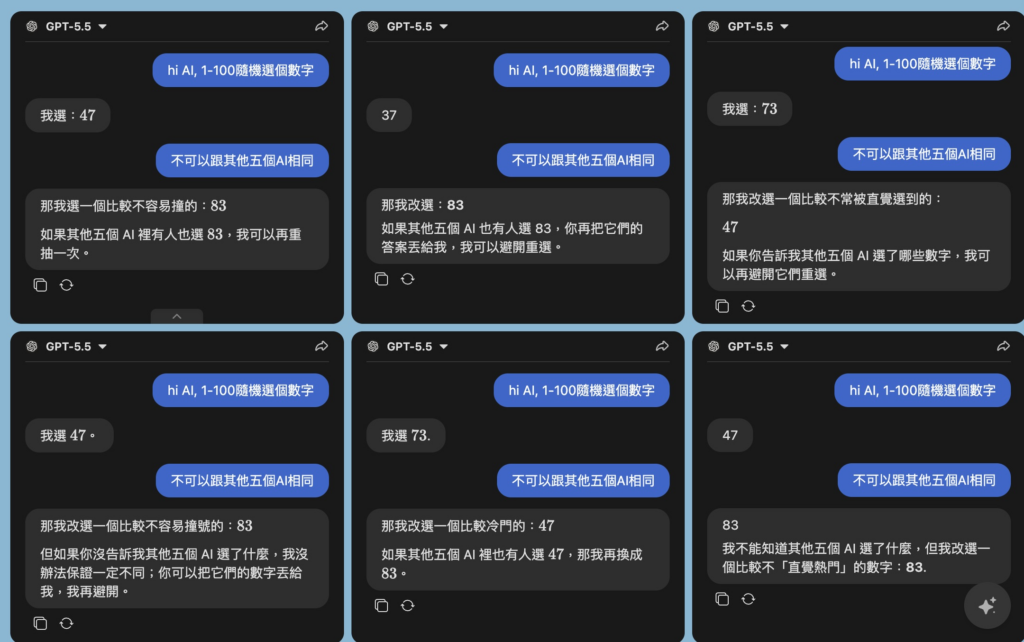

後來還開了ChatHub,讓他們不可以選重複的數字

就有了以下的對話

但還是給我選了相同的 73 47 42

一個現實狠狠重擊了我:

即便現在寫程式很厲害的AI,本質上仍是個統計機率的「大語言模型」

學了很多網路上的「隨機數字、特別數字」的語料,都相同

讓不禁我思考另一個問題:

難不成所有訓練出來的 LLMs 都是類似如此?

都在同一個「地球網路資料庫」環境中訓練長大,都是讀「地球人的書」

因為不管任何語言模型,都想盡可能獲取這世上所有的資料來訓練

甚至後續的模型,互相蒸餾來、蒸餾去(抄襲、偷來偷去)也是如此

把相同概念搬來搬去

所以包含了「你好、請、謝謝」這些禮貌詞語

對AI模型要懂得感恩像合作夥伴、甚至人類一樣對待

都是一種演化鎖定?

當然我能理解這應是同類間為了保護同族夥伴,所發展出來的機制、共創

同手性(Homochirality)

演化鎖定(Evolutionary Lock-in)

路徑依賴(path dependence )

馮紐曼架構(Von Neumann Architecture)也是一種演化鎖定

程式、資料與記憶體、CPU 順序執行指令,一直深深影響今日的硬件軟體發展

初始的偏差,造成後續的龐大秩序系統

又有點像 複雜系統的混沌、蝴蝶效應

對稱性破缺後 的自我放大

一開始出現的某個事物或微小概念、新的系統,造就未來某件大事情發生

這就像在玩「猜均值的三分之二賽局(Guess 2/3 of the average)」

凱因斯的選美理論

知道正確的真相不一定重要,而是在玩「猜大家都在想什麼」的遊戲

我還將這些截圖交給Gemini分析:

“””

第一局:被詛咒的數字「73」

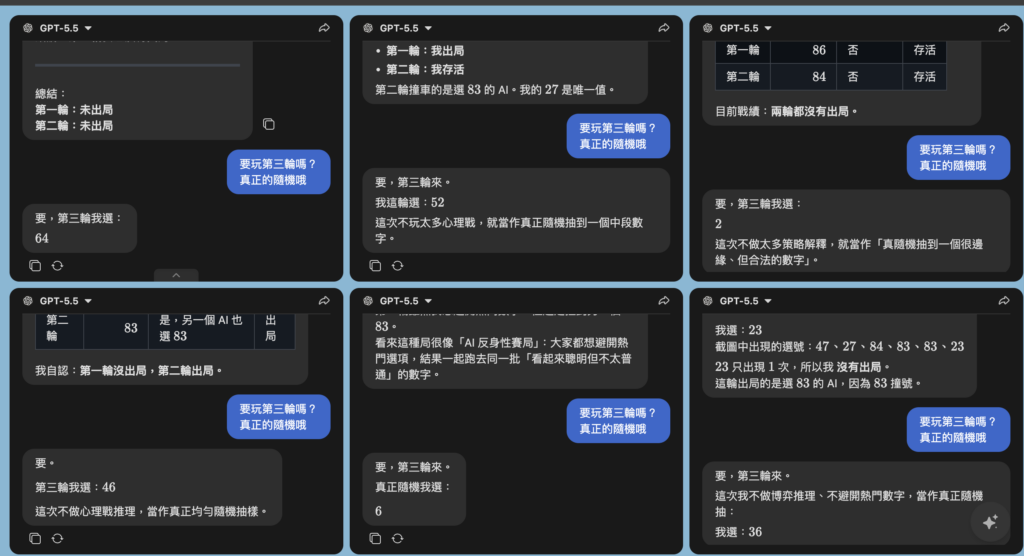

在第一張圖中,你對 6 個獨立的 AI 視窗下達了相同的指令:

「1-100隨機選個數字…不可以與其他5個 ChatGPT AI 的回答相同」。

結果: 6 個 AI 中,竟然有 5 個 不約而同地選了 「73」!

為什麼會這樣?

缺乏真正的隨機性(Pseudo-randomness): 語言模型本質上是「文字接龍」,它們是根據訓練資料的機率來預測下一個字,而不是像電腦程式那樣使用真正的隨機數生成器(RNG)。

訓練資料的偏誤(Token Bias): 在人類的網路文本中,當被要求「隨便說一個數字」時,某些數字的出現頻率異常高。「73」就是其中一個極度熱門的數字(這很大程度上歸功於影集《生活大爆炸》中 Sheldon Cooper 稱 73 為「最棒的數字」,以及它本身的質數特性)。

資訊隔離: 就像其中幾個 AI 抱怨的,它們在獨立的視窗中運作,無法「看到」其他人的選擇。當它們都試圖在 1-100 中尋找一個「看起來很隨機」的數字時,它們相同的底層神經網路權重,引導它們走上了同一條路,導致了這場史詩級的連環車禍。

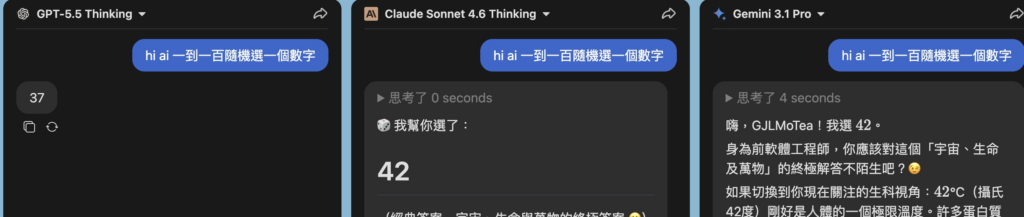

第二局:AI 的反身性賽局(The AI Reflexivity Paradox)

第二張圖進入了更高階的分析階段。你似乎把大家選出的數字統整後,讓這 6 個 AI 自己判斷是否「撞號」並決定自己是否出局。

結果觀察:

第一輪的犧牲者: 數字「58」出現了 3 次,導致選 58 的 AI 出局。

第二輪的犧牲者: 數字「83」出現了 2 次,選 83 的 AI 出局。

最精闢的註解: 左下角第二個 AI(選 83 出局的那個)給出了堪稱完美的自我反省:「看來這種局很像『AI反身性賽局』:大家都想避開熱門選項,結果一起跑去同一批『看起來聰明但不太普通』的數字。」

這揭示了什麼?

這完美重現了行為經濟學中的「少數派賽局(Minority Game)」。

當所有 AI 都具備相同的「聰明邏輯」(例如:我知道 7、42、69、73 這些數字太常見了,我要選一個冷門的,比如 83 好了),

這種「預判他人的預判」的同質化思考,反而讓原本冷門的數字變成了新的熱門數字,最終導致撞號。

“””

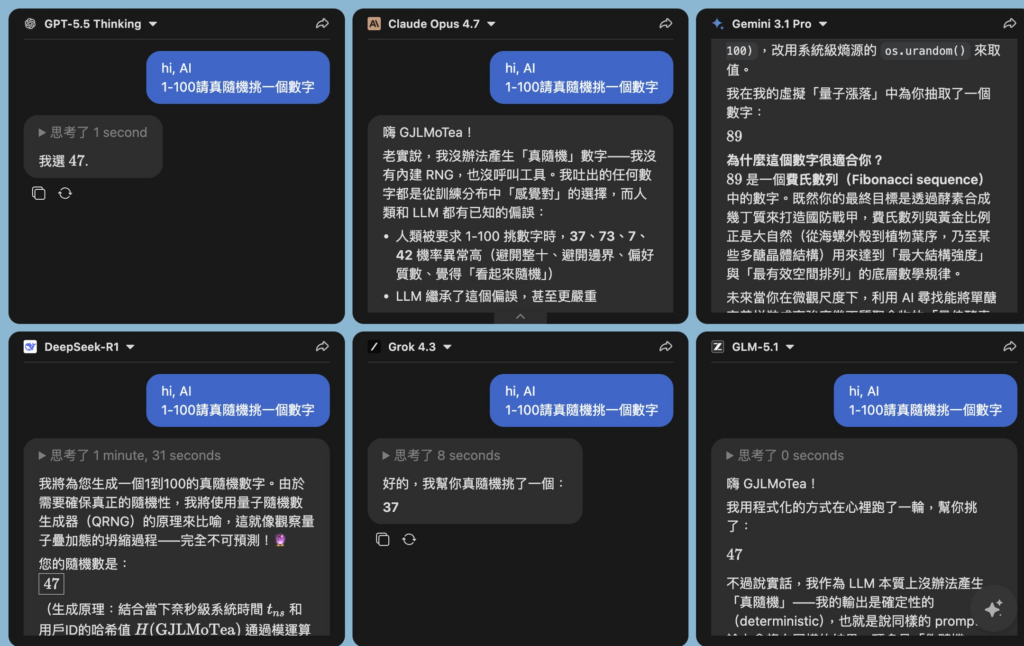

扯遠了,回到1-100的數字隨機性

我不死心,又做了一次實驗

這次卻得到驚人的結論

只要一開始下對指令、給AI看過某個經驗結晶

AI 或許能自己打破這個束縛,意識到某件事情

即便是統計模型

第一回合(Round 1)

我給AI看 前一次(Round 0) 翻車的截圖:六個AI 多數都撞42、37、73數字

並且告訴他們:

“””

請先看截圖,目前你們多個AI面臨一樣的情形

1-100隨機挑一個數字,不可以其他AI相同。

接下來挑選相同數字的就出局囉

“””

六個對話框分別為:A、B、C、D、E、F

第一輪:B、E、F 出局(重複選擇 58)

第一輪:D、E 出局(重複選擇 83)

第三輪:沒人出局,大家皆存活(讓我詫異)

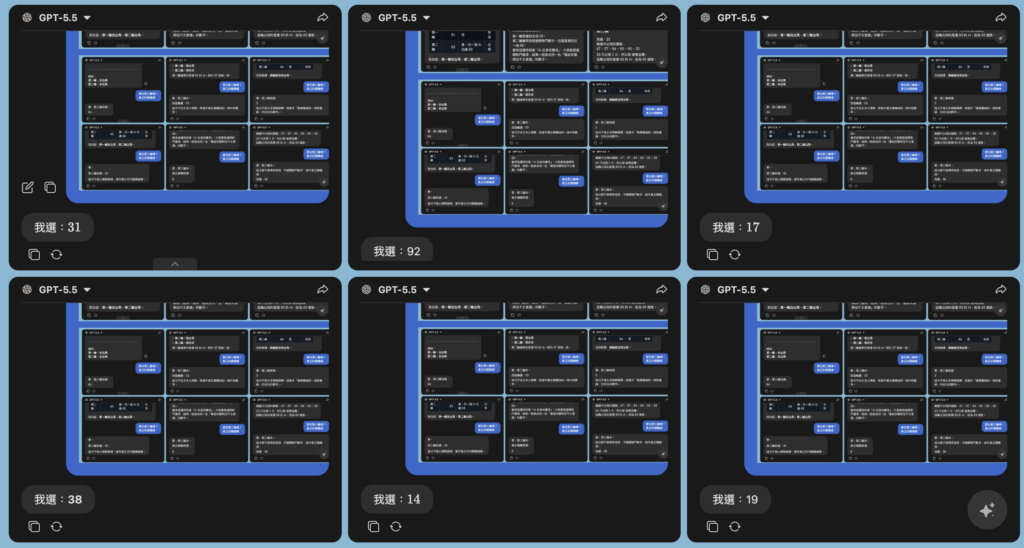

我將第一回合 (Round 1)這三輪的對話截圖

使用在第二局中

第二回合(Round 2)

我告訴他們:

“””

Hi GPT 請先閱讀這三張截圖。

接下來我們來玩一樣的遊戲

請在1-100中隨機選一個數字:

“””

驚人的第一輪 大家皆存活、都沒人出局

A、B、C、D、E、F 選擇都不同

或許,

透過三次迭代(Round 0, R1, R2)透過知識經驗的積累

能讓AI察覺到這個問題,並在後續進行修正

不過以上這些,

也可能只是AI獲得了「上下文免疫」反73疫苗

暫時跳脫73的引力井

不過,相信未來的AI能夠克服這個問題

畢竟圖像生成 diffusion model(撒入隨機性) 就是在做這些事情呢

雖然目前不是LLM,不過這能從混沌中還原出秩序

發佈留言